i punti principali

- Geoffrey Hinton afferma di essere preoccupato per la capacità dell’IA di creare immagini e testi falsi convincenti.

- Ha detto che era “difficile vedere come si potesse impedire ai cattivi di usarlo per cose cattive”.

- I CEO di Google, Microsoft, OpenAI e Anthropic incontreranno giovedì il vicepresidente degli Stati Uniti Kamala Harris.

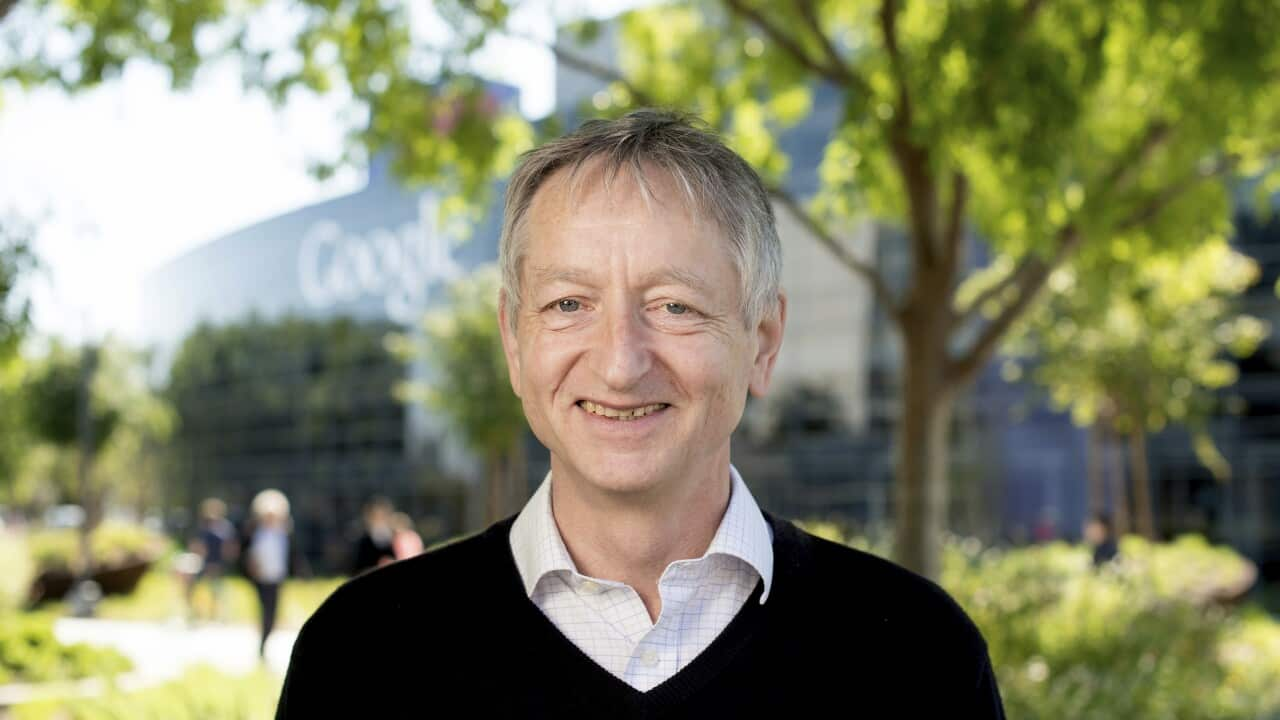

Uno dei pionieri dell’intelligenza artificiale ha affermato di aver lasciato Google per parlare liberamente dei pericoli della tecnologia, dopo aver realizzato che i computer potrebbero diventare più intelligenti delle persone molto prima di quanto lui e altri esperti avevano previsto.

“Sono partito per poter parlare dei pericoli dell’intelligenza artificiale senza pensare a come potrebbe influire su Google”, ha scritto Geoffrey Hinton su Twitter.

In un’intervista al New York Times, il signor Hinton ha affermato di essere preoccupato per la capacità dell’intelligenza artificiale di creare immagini e testi falsi convincenti, creando un mondo in cui le persone non sarebbero più in grado di dire cosa fosse reale.

“È difficile vedere come puoi impedire ai cattivi attori di usarli per cose cattive”, ha detto.

Si teme che la tecnologia possa sostituire rapidamente i lavoratori e diventare una minaccia maggiore man mano che apprende nuovi comportamenti.

“L’idea che queste cose possano effettivamente diventare più intelligenti delle persone – poche persone la pensano così”, ha detto al New York Times.

Ma la maggior parte delle persone pensava che fosse troppo inverosimile. E ho pensato che fosse irraggiungibile. Pensavo avesse dai 30 ai 50 anni o anche di più. Ovviamente, non la penso più così”.

Hinton ha affermato nel suo tweet che Google stesso “ha agito in modo molto responsabile” e ha negato di essersi licenziato per poter criticare il suo ex datore di lavoro.

Google non ha risposto immediatamente a una richiesta di commento di Reuters.

Il Times ha citato Jeff Dean, capo scienziato di Google, che ha dichiarato in una dichiarazione: “Rimaniamo impegnati in un approccio responsabile all’intelligenza artificiale. Impariamo costantemente a comprendere i rischi emergenti, innovando con coraggio”.

È tempo di regolamentare l’intelligenza artificiale?

Da quando OpenAI, supportato da Microsoft, ha lanciato ChatGPT a novembre, il numero crescente di applicazioni di “intelligenza artificiale” in grado di generare testo o immagini ha sollevato preoccupazioni sulla futura regolamentazione della tecnologia.

“Il fatto che così tanti esperti abbiano espresso le loro preoccupazioni sulla sicurezza dell’IA, con alcuni scienziati informatici che si sono spinti fino a rimpiangere parte del loro lavoro, dovrebbe preoccupare i responsabili politici”, ha affermato Carissa Velez, professore associato di filosofia all’Università di Oxford. Istituto per l’etica nell’intelligenza artificiale.

“È ora di regolamentare l’IA”, ha detto.

La Casa Bianca invita le aziende tecnologiche a parlare dei pericoli dell’intelligenza artificiale

Secondo un funzionario della Casa Bianca, giovedì gli amministratori delegati di Google, Microsoft, OpenAI e Anthropic incontreranno il vicepresidente degli Stati Uniti Kamala Harris e gli alti funzionari dell’amministrazione per discutere le questioni chiave dell’IA.

L’invito agli amministratori delegati, visto da Reuters, ha rilevato “l’aspettativa del presidente Joe Biden che aziende come la tua dovrebbero garantire che i loro prodotti siano sicuri prima che vengano messi a disposizione del pubblico”.

Le preoccupazioni per la tecnologia AI in rapida crescita includono violazioni della privacy, pregiudizi e timori che frodi e disinformazione possano diffondersi.

Ad aprile, Biden ha affermato che non era ancora chiaro se l’intelligenza artificiale fosse pericolosa, ma ha sottolineato che le aziende tecnologiche hanno la responsabilità di garantire la sicurezza dei loro prodotti.

Ha detto che i social media hanno già mostrato il danno che le potenti tecnologie potrebbero fare senza le giuste tutele.

L’amministrazione chiede inoltre un commento pubblico sulle misure di responsabilità proposte per i sistemi di intelligenza artificiale, poiché crescono le preoccupazioni per il loro impatto sulla sicurezza nazionale e sull’istruzione.

Lunedì, i legislatori del White House Domestic Policy Council e dell’Office of Science and Technology Policy della Casa Bianca hanno scritto in un blog su come la tecnologia potrebbe rappresentare un grave pericolo per i lavoratori.

Le due società non hanno risposto immediatamente a una richiesta di commento.

ChatGPT, un programma di intelligenza artificiale in grado di scrivere risposte rapide a una vasta gamma di domande, in particolare ha attirato l’attenzione dei legislatori statunitensi poiché è diventata l’applicazione consumer in più rapida crescita nella storia con oltre 100 milioni di utenti attivi mensili.

“Penso che dobbiamo stare attenti con l’intelligenza artificiale, e penso che dovrebbe esserci una supervisione del governo perché è un pericolo per il pubblico”, ha detto il mese scorso il CEO di Tesla Elon Musk in un’intervista televisiva.

More Stories

Valve lancia un “sistema di aiuto” per le recensioni degli utenti di Steam

Le creature più antiche e più piccole della Terra sono destinate a diventare le vincitrici del cambiamento climatico – e le conseguenze potrebbero essere disastrose

Il Day To Night Bistro Elio’s Place apre in Flinders Lane